Claude Mythos : l’IA autonome qui menace la sécurité des banques

Avec l’émergence d’IA capables d’identifier puis d’exploiter des failles jusqu’alors invisibles, la cybersécurité financière entre dans une nouvelle ère de risque systémique.

L’annonce, en avril 2026, du modèle d'IA Claude Mythos Preview d’Anthropic et du projet Glasswing, une initiative majeure de cybersécurité dirigée par le modèle, a provoqué un choc dans l’écosystème financier. Doté de capacités dites « agentiques », ce modèle serait capable d’identifier puis d’exploiter des failles logicielles dans les principaux systèmes d’exploitation et navigateurs.

Au même moment, le rapport Global AI in Financial Services Report 2026 du Cambridge Centre for Alternative Finance (CCAF) montrait à quel point les institutions financières ont accéléré leur adoption de l’IA : 81 % des entreprises du secteur y ont recours à divers degrés et 40 % déclarent un niveau d’intégration avancé – correspondant aux phases dites de “scaling” ou de “transforming”. [1]

Sections principales de l'article :

- Claude Mythos ou la fin de l’innocence numérique

- Le vrai goulet d’étranglement : réparer, pas découvrir

- Réguler l’IA par l’IA : une fausse évidence

- La dépendance privée comme risque systémique

- Ce qu’il faudrait vraiment faire

- La machine ne doit pas devenir le souverain

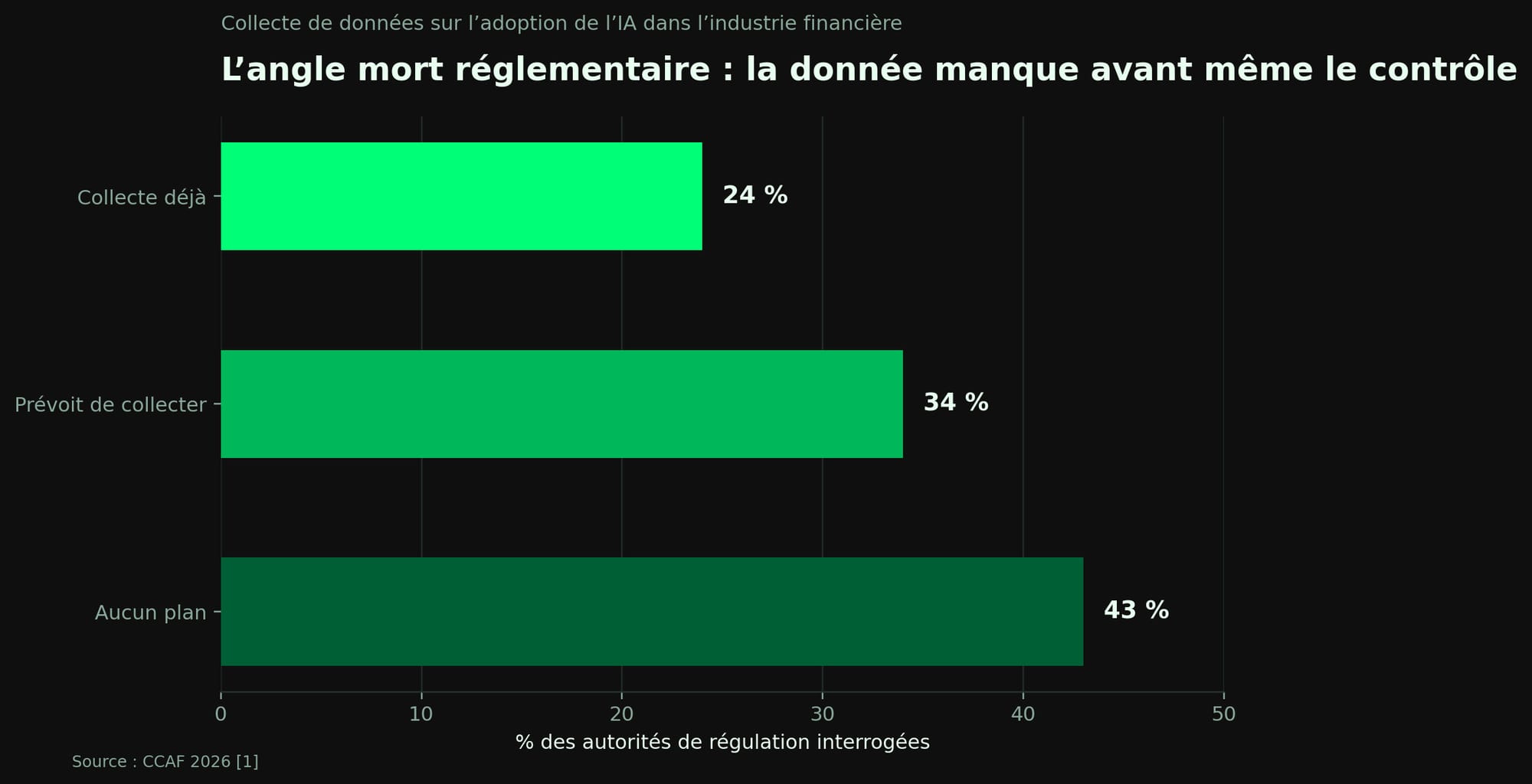

Plus troublant encore, seulement 24 % des autorités collectent des données sur l’usage de l’IA dans le secteur, tandis que 43 % n’ont pas prévu de le faire dans les deux ans. [1] Autrement dit, la machine financière accélère tandis que le tableau de bord public demeure partiellement éteint.

Pendant que l’industrie financière automatise ses décisions, ses contrôles, son code – et parfois même ses réflexes de défense – une partie des autorités ignore encore précisément où l’IA est déjà déployée. Il ne s’agit plus d’un simple retard administratif, mais d’une véritable asymétrie de puissance.

Le déséquilibre est désormais manifeste : les institutions financières industrialisent l’usage de l’IA tandis que les régulateurs peinent encore à suivre le rythme de cette transformation.

Face à ce retard, certains plaident pour que les superviseurs se dotent de leurs propres IA agentiques. Mais une telle course aux armements technologiques est-elle réellement souhaitable ?

Claude Mythos ou la fin de l’innocence numérique

Anthropic affirme que Claude Mythos Preview (si la mention "Preview" a été ajoutée, c'est parce que la version actuelle n'est pas encore prête pour un usage grand public, ironiquement en raison sa trop grande puissance) peut identifier puis exploiter des vulnérabilités inédites dans les principaux systèmes d’exploitation et navigateurs, y compris en élaborant des chaînes d’attaque complexes. [2]

Ce n’est plus seulement « trouver une erreur dans du code », c’est transformer une faiblesse dormante en trajectoire d’intrusion. Le discours officiel parle de défense. Il n’est pas faux : détecter les failles avant les attaquants peut sauver des infrastructures.

Mais ce récit oublie une évidence gênante : un outil capable de protéger en exploitant reste aussi un outil capable d’attaquer. La frontière morale ne réside pas dans le modèle lui-même, mais dans les conditions de son usage : accès, garde-fous, journaux d’audit, décisions humaines – tout ce que la course à la puissance tend précisément à reléguer au second plan.

Le projet Glasswing constitue la réponse officielle d’Anthropic à cette inquiétude : accorder un accès restreint à Claude Mythos à quelques grands acteurs technologiques, financiers et de cybersécurité, afin qu’ils puissent identifier et corriger les failles avant qu’elles ne soient exploitées ailleurs. [2]

Il s'agit en effet d'une initiative de cybersécurité unissant Anthropic avec d'autres géants de la tech (Apple, Google, Microsoft, Amazon, Nvidia) et visant à sécuriser des systèmes informatiques critiques en utilisant Claude Mythos.

Sur le papier, l’initiative prend les traits d’un bouclier. Cependant, en réalité, elle révèle aussi le cœur du problème : la sécurité numérique dépend désormais d’un cercle restreint d’entreprises privées capables de voir les vulnérabilités avant les autres.

Le projet Glasswing ne supprime donc pas le risque systémique, mais le déplace vers des questions de gouvernance, d’accès et de confiance. Qui décide des failles à corriger en priorité ? Qui vérifie que l’avantage défensif ne se transforme pas en privilège stratégique ?

Le vrai goulet d’étranglement : réparer, pas découvrir

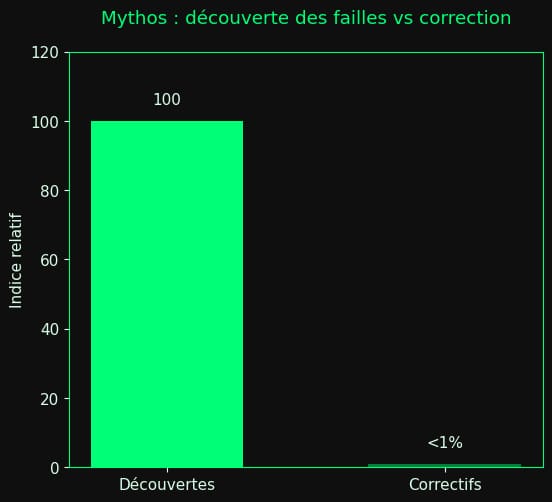

Le fantasme dominant reste celui d’une découverte totale : une IA capable de voir toutes les failles, partout et plus vite que les humains. Pourtant, la sécurité ne se joue pas au moment où une vulnérabilité est détectée, mais lorsqu’elle est effectivement corrigée.

Forrester souligne ainsi que Claude Mythos déplace brutalement le centre du problème : la découverte des vulnérabilités pourrait désormais croître de manière exponentielle, tandis que leur correction demeure lente, coûteuse, humaine et souvent sous-financée. [3]

C’est là que le récit héroïque se fissure. Une IA peut produire une avalanche d’alertes, mais elle ne crée pas automatiquement les équipes, les budgets, les arbitrages et les fenêtres de maintenance nécessaires. Voir toutes les fissures d’un barrage ne sert à rien si personne ne dispose du béton nécessaire pour les colmater.

Réguler l’IA par l’IA : une fausse évidence ?

Face à cette asymétrie, une idée circule : doter les régulateurs de leurs propres agents. En apparence, l’idée paraît logique. Si les banques utilisent des systèmes autonomes, les superviseurs devraient disposer d’outils aussi rapides.

Ce raisonnement installe cependant une logique dangereuse : pour surveiller des agents, il faudrait produire d’autres agents et pour contenir des systèmes autonomes, il faudrait multiplier les systèmes autonomes. Ce n’est plus de la régulation, c’est une logique de course aux armements appliquée à l’administration elle-même.

Le problème n’est pas que les autorités utilisent l’IA. Elles devront probablement le faire. Le problème est de croire qu’un agent plus puissant remplace une doctrine claire.

Sans données fiables, sans obligations de déclaration, sans contrôle humain traçable ni responsabilité juridique clairement établie, une IA de supervision risque surtout de devenir le reflet opaque des systèmes qu’elle prétend encadrer.

La dépendance privée comme risque systémique

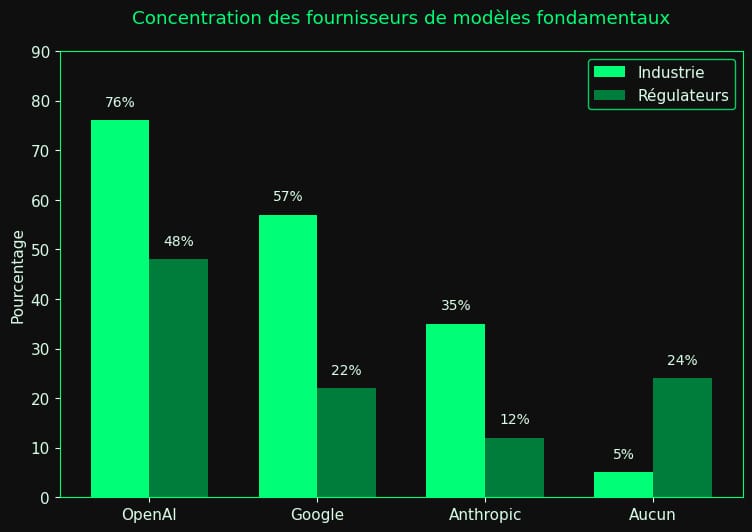

L’autre angle mort est la concentration. Le rapport du CCAF indique qu’OpenAI est le fournisseur de modèles le plus utilisé : 76 % dans l’industrie financière, 48 % chez les régulateurs, tandis que Google et Anthropic suivent à distance. [1]

Le sujet n’est pas de déterminer quel fournisseur serait le plus performant. Il est de comprendre ce qui se produit lorsque le système financier mondial repose sur un nombre limité d’architectures privées.

Une panne majeure, une restriction d’accès, une hausse tarifaire, une faille critique ou une décision politique prise par l’un de ces acteurs pourraient alors produire des effets systémiques immédiats. La finance a déjà connu les risques de concentration dans les chambres de compensation, les infrastructures de paiement et le cloud.

Elle les recrée aujourd’hui dans les modèles d’IA. La souveraineté ne consiste pas à tout construire seul, elle consiste à ne pas dépendre d’un interrupteur qu’un autre peut actionner.

Ce qu’il faudrait vraiment faire

La réponse ne devrait pas être : « donnons Claude Mythos aux régulateurs. » Elle devrait être : « rendons l’écosystème moins fragile. »

- Première priorité : imposer une cartographie obligatoire des usages de l’IA dans la finance. Quels modèles sont utilisés ? Quels fournisseurs ? Quelles données ? Pour quelles fonctions critiques ? Quels incidents ont déjà été observés ? Sans cette base, la régulation reste une conversation dans le brouillard.

- Deuxième priorité : un agent peut détecter, classer ou proposer. Mais toute exploitation active, toute correction automatisée ou toute intervention sur un système critique doit demeurer associée à une responsabilité humaine identifiable et vérifiable.

- Troisième priorité : financer la réparation. Les modèles comme Claude Mythos rendront visibles des milliers de failles. Il faudra des équipes pour les corriger, notamment dans l’open source, dont dépend une part immense de l’infrastructure financière. [3]

- Quatrième priorité : diversifier les fournisseurs. Les régulateurs devraient exiger des plans de sortie, des tests de portabilité, des modèles alternatifs et des audits indépendants. La résilience naît de la pluralité, non d’une dépendance sophistiquée.

La machine ne doit pas devenir le souverain

Claude Mythos annonce moins l’arrivée d’un nouveau produit que celle d’un nouveau régime technique : celui où les machines ne se contentent plus de conseiller, mais explorent, enchaînent, agissent et testent les limites.

Dans ce régime, la question centrale n’est pas « quelle IA est la plus puissante ? ». La question est : qui conserve le droit de ralentir ? La finance rêve d’une sécurité à vitesse machine. Les États rêvent déjà d’une supervision à vitesse machine. Mais une société qui ne sait plus ralentir ses propres systèmes confond puissance et perte de contrôle.

Claude Mythos peut contribuer à protéger les infrastructures. Mais sans transparence, sans pluralité et sans responsabilité humaine clairement assumée, il risque surtout de transformer la cybersécurité en un théâtre d’ombres automatisé.

Sources principales :

- [1] 2026 Global AI in Financial Services Report. | Cambridge Centre for Alternative Finance (CCAF) (jbs.cam.ac.uk)

- [2] Assessing Claude Mythos Preview’s cybersecurity capabilitie. | Anthropic Red Team (red.anthropic.com)

- [3] Project Glasswing: The 10 Consequences Nobody’s Writing About Ye. |Forrester (forrester.com)