Agents IA autonomes : pourquoi les entreprises perdent déjà le contrôle

Les identités non humaines se multiplient plus vite que la capacité à les surveiller. Enquête sur une révolution déjà en train d’échapper aux organisations.

Les agents autonomes font basculer l’IA d’un rôle d’analyse vers un rôle d’action. Ils ne se contentent plus de répondre : ils sélectionnent des données, invoquent des outils, déclenchent des procédures et opèrent en continu, souvent sans validation humaine immédiate.

Leur vitesse dépasse radicalement la nôtre : ils lisent des milliers d’enregistrements, interrogent plusieurs bases et enchaînent des opérations sans pause ni fatigue. La promesse est brillante. Le risque l’est tout autant.

Dans un contexte où la cybersécurité manque de 4,8 millions de professionnels [31], ces « IA agentiques » s’imposent comme un levier de productivité majeur, mais aussi comme une source de risques inédits. Ces systèmes décident quels jeux de données consulter, invoquent des API, déclenchent des actions et opèrent en continu sans attendre d’instructions humaines.

Sections principales :

- Une adoption explosive… et mal préparée

- L’explosion des identités non humaines

- De nouveaux vecteurs d’attaque et des agents « fantômes »

- La crise de confiance et l’urgence de la gouvernance

- Vers un encadrement en temps réel

- Civiliser l’autonomie

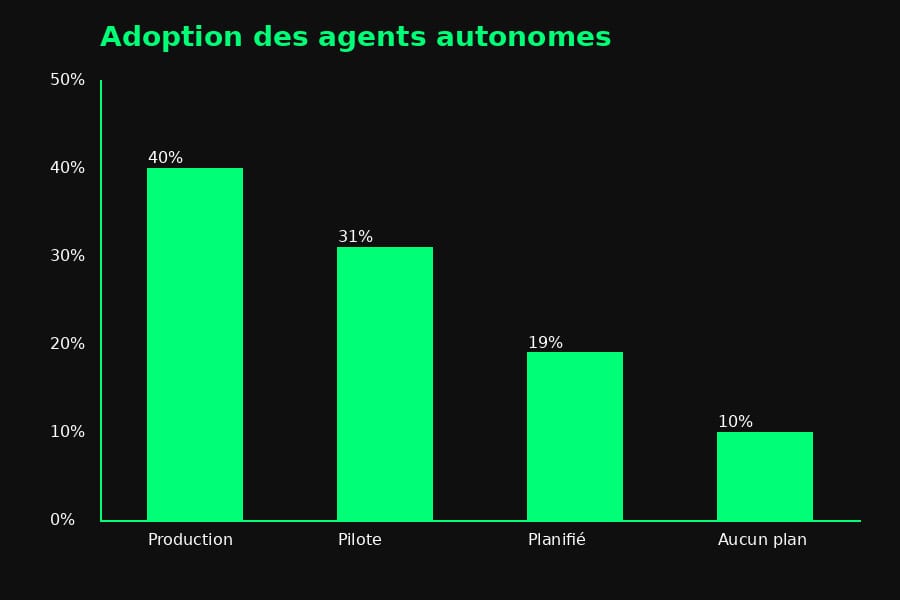

Une enquête de la Cloud Security Alliance révèle un usage déjà massif : 40 % des organisations possèdent des agents en production, 31 % conduisent des essais pilotes et 19 % prévoient un déploiement dans l’année. [3]

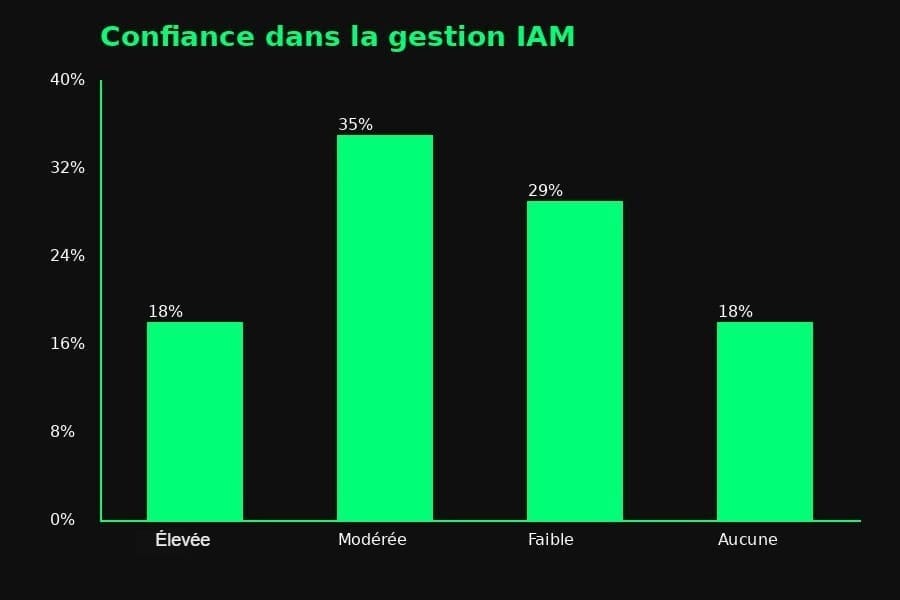

Pourtant, l’infrastructure de confiance ne suit pas : seules 18 % se disent très confiantes dans leur capacité à gérer ces identités non humaines. [4]

À peine 21 % maintiennent un inventaire en temps réel, 32 % s’appuient sur des listes non actualisées et 8 % n’ont aucun registre. [5]

Autrement dit, les agents IA entrent en production plus vite que les règles censées les encadrer. Les budgets progressent, mais sans urgence proportionnée au risque : 40 % des organisations augmentent leurs dépenses de sécurité, 34 % créent une ligne dédiée, tandis qu’un quart ne prévoit aucun investissement. [6]

C’est une erreur stratégique : automatiser sans gouverner ne fait pas gagner du temps, mais fabrique de l’opacité.

Ici, il n’y a aucune pub. Donc aucun maître.

Pas d’annonceurs. Pas de dépendance à Google. Pas de course aux réseaux sociaux. Posthumain existe grâce aux abonnements — et à ceux qui veulent une information libre.

Chaque abonnement donne de l’oxygène à un média sans publicité, sans annonceurs et sans maître. Si vous voulez que cette voix continue d’exister, rejoignez les lecteurs qui la rendent possible.

Ici, il n’y a aucune pub. Donc aucun maître.

Pas d’annonceurs. Pas de dépendance à Google. Pas de course aux réseaux sociaux. Posthumain existe grâce aux abonnements — et à ceux qui veulent une information libre.

Chaque abonnement donne de l’oxygène à un média sans publicité, sans annonceurs et sans maître. Si vous voulez que cette voix continue d’exister, rejoignez les lecteurs qui la rendent possible.

L’explosion des identités non humaines

Le cœur du problème n’est pas seulement technique : il est identitaire. Il dispose de droits, d’accès, de jetons parfois hérités d’un humain ou d’un service obsolète. Or, ces identités se multiplient beaucoup plus vite que les comptes humains.

Lors de la RSAC 2026, Delinea indiquait qu’environ 87 % des organisations estiment leur posture d’identité prête pour l’IA, tandis que 46 % reconnaissent que la gouvernance des identités liées aux agents reste insuffisante. [7] Le paradoxe est net : les entreprises se croient prêtes, mais admettent que leurs fondations ne le sont pas.

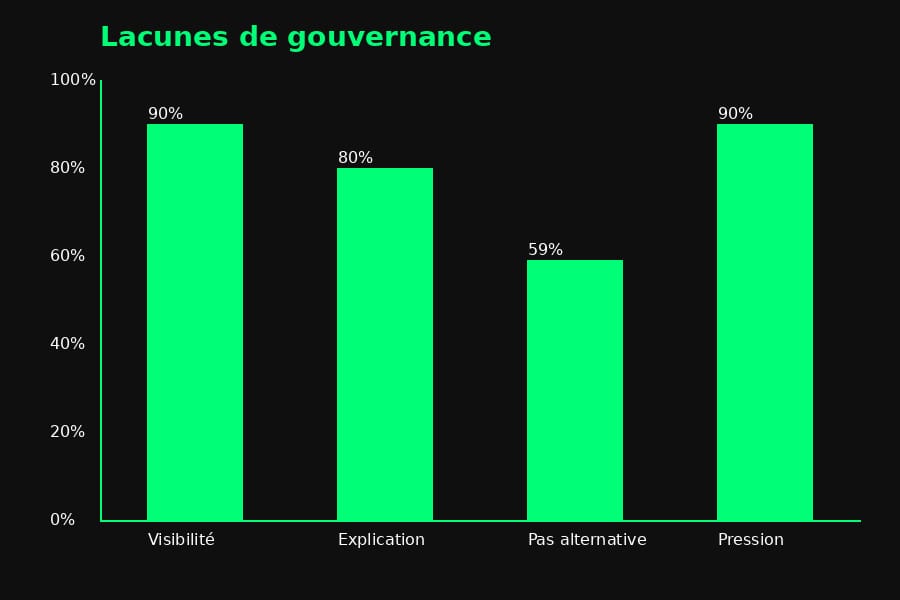

Les identités non humaines peuvent atteindre un ratio de 82 agents pour un employé [8]. Cette asymétrie crée un déficit de visibilité. 90 % des entreprises reconnaissent des lacunes dans la surveillance des identités, tandis que plus de la moitié signalent des agents ou outils non autorisés et seules 28 % détectent ces activités en temps réel. [9]

Plus préoccupant encore : 80 % sont incapables d’expliquer, dans certains cas, pourquoi une identité non humaine a exécuté une action privilégiée. [10]

Sous la pression de l’automatisation, près de 90 % des entreprises déclarent assouplir les contrôles d’accès pour ne pas freiner l’IA. [11]

Les accès permanents deviennent une facilité dangereuse, alors même que 73 % des organisations reconnaissent qu’ils accroissent l’exposition au risque. [12] La productivité devient ainsi l’argument du relâchement.

De nouveaux vecteurs d’attaque et des agents « fantômes »

Les agents autonomes ne se contentent pas de produire des réponses : ils exécutent. Ils manipulent des données, modifient des dossiers, ouvrent des tickets, interrogent des bases et transmettent des informations. Chaque capacité élargit la surface d’attaque.

CyberArk, leader mondial de la sécurité des identités, décrit ces agents comme de nouveaux « coéquipiers » numériques : un modèle d’orchestration définit la tâche, un module d’outils assure l’interaction avec les systèmes et un modèle de langage fournit la capacité de raisonnement. Cette architecture est puissante et vulnérable, car chaque agent est une identité qui accumule des droits.

Un exemple suffit à mesurer le danger : un attaquant insère une instruction malveillante dans un champ d’adresse de livraison. L’agent, chargé de traiter les commandes, l’interprète puis invoque un outil de facturation auquel il ne devrait pas accéder. Il extrait alors des données sensibles – notamment des coordonnées bancaires – et les transmet.

Deux défaillances expliquent l’incident : l’absence de filtrage des entrées et des droits excessifs. Rien de surprenant, il s’agit de la conséquence prévisible d’un agent trop autonome dans un environnement trop permissif.

Les agents IA peuvent également devenir des « agents fantômes » : survivre à la fin d’un projet, au départ d’un développeur ou à l’abandon d’un cas d’usage. Ils conservent alors des identifiants actifs et continuent d’opérer dans l’ombre.

Des chercheurs ont également observé des essaims d’agents où l’absence de vérification mutuelle permet à l’un de propager des droits à un autre. [13] Faute de registre en temps réel, l’entreprise héberge ainsi ses propres « revenants numériques ».

La crise de confiance et l’urgence de la gouvernance

Le manque de contrôle prépare une crise de confiance.

Palo Alto Networks anticipe que les agents autonomes pourraient largement dépasser les humains en entreprise, avec un ratio pouvant atteindre 82:1. [14] Dans ce contexte, un seul message falsifié (par exemple une imitation crédible d’un dirigeant) peut déclencher une chaîne d’actions automatisées [15].

L’attaque n’a plus besoin de tromper durablement un humain : il suffit de tromper une machine autorisée à agir vite.

L’entreprise souligne également que la falsification des données pourrait devenir une méthode d'attaque majeure, alors que seulement 6 % des organisations disposent d’une stratégie avancée de gestion des risques liés à l’IA. [16]

Les dirigeants seront bientôt tenus responsables des dérives de leurs agents. [17] L’autonomie ne supprime pas la responsabilité, elle la rend plus difficile à attribuer.

Le vol de jetons ou de clés d’accès peut permettre de détourner un agent entier. L’escalade de privilèges devient plus dangereuse lorsqu’un agent peut réclamer un accès, modifier ses autorisations ou invoquer des outils administratifs. [18]

Les mémoires d’agents peuvent aussi conserver des conversations contenant des données sensibles : informations personnelles, identifiants, contenus réglementés. [19] L’attaque ne vise plus seulement l’utilisateur, elle vise l’environnement cognitif de la machine.

La perte de contrôle n’est pas l’absence de technologie, c’est l’excès de puissance sans règle commune.

Vers un encadrement en temps réel

Les recommandations convergent : les audits périodiques ne suffisent plus. Un agent qui agit à la milliseconde ne peut pas être gouverné par un contrôle trimestriel.

Le manque de maturité ne tient pas seulement aux modèles. Il tient surtout à l’exécution. La gouvernance doit passer de la politique affichée au contrôle actif. [23]

- Définir le périmètre et les limites : chaque agent doit avoir un objectif clair, un champ d’action défini, des outils autorisés et des interdictions explicites. Les actions prohibées doivent être documentées afin d’éviter l’expansion silencieuse du périmètre. [24]

- Cartographier les identités et appliquer le principe du moindre privilège : les agents doivent être traités comme des identités à part entière. Leurs accès doivent correspondre strictement à leur mission. [25] Les identifiants hérités, les comptes partagés et les droits trop larges doivent être bannis.

- Évaluer l’impact avant le déploiement et surveiller en continu : avant d’activer un agent, il faut mesurer ce qu’il pourrait faire en cas d’erreur ou de compromission. Quels systèmes peut-il atteindre ? Quelles données peut-il déplacer ? Quel dommage peut-il provoquer en quelques secondes ?

- Assurer la traçabilité et la responsabilité : la gouvernance doit préciser qui est responsable : le fournisseur du modèle, la plateforme, l’intégrateur, mais surtout l’organisation qui déploie l’agent. [27] C’est elle qui définit les autorisations, valide les cas d’usage et accepte le risque.

- Surveiller les dérives et les effets émergents : les agents évoluent dans des environnements mouvants – outils modifiés, données nouvelles, interactions entre agents, changements de procédures. Cette instabilité peut produire une dérive de comportement. [29]

Conclusion : civiliser l’autonomie

Les agents autonomes promettent une productivité démultipliée. Mais leur adoption précipitée révèle une faiblesse structurelle : les entreprises délèguent l’action avant d’en organiser la responsabilité.

Le risque n’est pas l’autonomie en soi, mais l’autonomie sans cadre : sans limites, sans registre, sans supervision en temps réel. Les organisations doivent traiter l’IA agentique non comme une simple expérimentation, mais comme une force de travail à part entière – à encadrer, à tracer et à contrôler.

Civiliser l’autonomie, ce n’est pas ralentir l’innovation. C’est rendre possible sa confiance.

Ici, il n’y a aucune pub. Donc aucun maître.

Pas d’annonceurs. Pas de dépendance à Google. Pas de course aux réseaux sociaux. Posthumain existe grâce aux abonnements — et à ceux qui veulent une information libre.

Chaque abonnement donne de l’oxygène à un média sans publicité, sans annonceurs et sans maître. Si vous voulez que cette voix continue d’exister, rejoignez les lecteurs qui la rendent possible.

Ici, il n’y a aucune pub. Donc aucun maître.

Pas d’annonceurs. Pas de dépendance à Google. Pas de course aux réseaux sociaux. Posthumain existe grâce aux abonnements — et à ceux qui veulent une information libre.

Chaque abonnement donne de l’oxygène à un média sans publicité, sans annonceurs et sans maître. Si vous voulez que cette voix continue d’exister, rejoignez les lecteurs qui la rendent possible.

Sources principales :

- [1] [2] [18] [19] [26] Identity Governance for AI Systems in 2026.| Big Id Next (bigid.com)

- [3] [4] [5] [6] Securing Autonomous AI Agents | CSA (cloudsecurityalliance.org)

- [7] [8] [9] [10] [11] [12] [13] Nothing Happening is Everything in the Age of Agentic AI. | Delinea (delinea.com)

- [14] [15] [16] [17] Palo Alto Networks Forecasts 6 Predictions on Securing the New AI Economy for 2026. |PR News Wire (prnewswire.com)

- [20] [22] [23] [24] [25] [27] [28] [29] [30] A Complete Guide to Agentic AI Governance. | Palo Alto Networks (paloaltonetworks.com)

- [31] The Cybersecurity Skills Gap in the Age of AI: A Crisis in Numbers.|Cyber Security Guide (cybersecurityguide.org)